Die Programmiersprache Rust

von Steve Klabnik, Carol Nichols und Chris Krycho, unter Mitarbeit der Rust-Gemeinschaft; übersetzt ins Deutsche von der Rust-Gemeinschaft

Diese Version des Textes geht davon aus, dass du Rust 1.90.0 (veröffentlicht am

2025-09-18) oder neuer mit edition = "2024" in der Datei Cargo.toml aller

Projekte verwendest, damit sie die Idiome der Rust-Edition 2024 verwenden.

Siehe Abschnitt „Installation“ in Kapitel 1 zum Installieren und

Aktualisieren von Rust sowie Anhang E für Informationen zu den

Editionen.

Die HTML-Version ist online verfügbar unter

https://doc.rust-lang.org/stable/book/ (englisches Original) und

unter https://rust-lang-de.github.io/rustbook-de/ (deutsche

Übersetzung). Die englische Fassung ist zudem offline in Rust-Installationen,

die mit rustup installiert wurden, verfügbar; führe rustup doc --book aus,

um sie zu öffnen.

Es sind weitere Übersetzungen durch die Gemeinschaft verfügbar.

Der englische Text ist als Taschenbuch und E-Book bei No Starch Press erhältlich, den deutschen Text gibt es ebenfalls als Taschenbuch und E-Book.

Vorwort

Die Programmiersprache Rust hat in wenigen Jahren einen langen Weg zurückgelegt, von ihrer Entstehung und Entwicklung durch eine kleine, noch junge Gemeinschaft von Enthusiasten bis hin zu einer der beliebtesten und gefragtesten Programmiersprachen der Welt. Rückblickend war es unvermeidlich, dass die Leistungsfähigkeit und das Potenzial von Rust Aufmerksamkeit erregten und sich in der Systemprogrammierung etablierten. Nicht unvermeidlich war jedoch das weltweit wachsende Interesse und die Innovationskraft, die sich in Open-Source-Gemeinschaften verbreiteten und eine breite Akzeptanz in verschiedenen Branchen begünstigten.

Zum jetzigen Zeitpunkt ist es einfach, auf die wunderbaren Funktionen hinzuweisen, die Rust zu bieten hat, um diese explosionsartige Zunahme des Interesses und der Akzeptanz zu erklären. Wer möchte nicht Speichersicherheit, und schnelle Leistung, und einen benutzerfreundlichen Compiler, und großartige Werkzeuge, neben einer Vielzahl anderer wunderbarer Funktionen? Die Sprache Rust, wie du sie heute kennst, vereint jahrelange Forschung im Bereich der Systemprogrammierung mit dem praktischen Wissen einer lebendigen und leidenschaftlichen Gemeinschaft. Diese Sprache wurde mit Bedacht entwickelt und sorgfältig gestaltet, um Entwicklern ein Werkzeug an die Hand zu geben, mit dem sie sicheren, schnellen und zuverlässigen Code einfacher schreiben können.

Was Rust jedoch wirklich besonders macht, sind seine Wurzeln, die dir, dem Benutzer, die Möglichkeit geben, deine Ziele zu erreichen. Diese Sprache möchte, dass du erfolgreich bist, und das Prinzip der Befähigung zieht sich wie ein roter Faden durch die Gemeinschaft, die diese Sprache entwickelt, pflegt und fördert. Seit der letzten Ausgabe dieses Standardwerks hat sich Rust zu einer wirklich globalen und vertrauenswürdigen Sprache weiterentwickelt. Das Rust-Projekt wird nun tatkräftig von der Rust Foundation unterstützt, die auch in wichtige Initiativen investiert, um die Sicherheit, Stabilität und Nachhaltigkeit von Rust zu gewährleisten.

Diese Ausgabe von „Die Programmiersprache Rust“ ist eine umfassende Aktualisierung, die die Entwicklung der Sprache im Laufe der Jahre widerspiegelt und wertvolle neue Informationen liefert. Aber dieses Buch ist nicht nur ein Leitfaden für Syntax und Bibliotheken – es ist eine Einladung, Teil einer Gemeinschaft zu werden, die Wert auf Qualität, Leistung und durchdachtes Design legt. Egal, ob du ein versierter Entwickler bist, der Rust zum ersten Mal ausprobieren möchte, oder ein erfahrener Rust-Entwickler, der seine Fähigkeiten verfeinern möchte, diese Ausgabe bietet für jeden etwas.

Die Entwicklung von Rust war geprägt von Zusammenarbeit, Lernen und Iteration. Das Wachstum der Sprache und ihres Ökosystems spiegelt direkt die lebendige, vielfältige Gemeinschaft wider, die dahinter steht. Die Beiträge Tausender Entwickler, von Kernsprachenentwicklern bis hin zu gelegentlichen Mitwirkenden, machen Rust zu einem so einzigartigen und leistungsstarken Werkzeug. Mit diesem Buch lernst du nicht nur eine neue Programmiersprache, sondern schließt dich einer Bewegung an, die Software besser, sicherer und angenehmer macht.

Willkommen in der Rust-Gemeinschaft!

– Bec Rumbul, Geschäftsführerin der Rust Foundation

Einführung

Willkommen im Buch Die Programmiersprache Rust, einem einführenden Buch über Rust. Die Programmiersprache Rust hilft dir, schnellere und zuverlässigere Software zu schreiben. Ergonomie und systemnahe Kontrolle stehen beim Entwurf von Programmiersprachen oft im Widerspruch – Rust stellt sich diesem Konflikt. Durch den Ausgleich zwischen leistungsstarken, technischen Möglichkeiten und einer großartigen Entwicklererfahrung bietet dir Rust die Möglichkeit, Details systemnah (z.B. Speichernutzung) zu kontrollieren, ohne den ganzen Ärger, der damit typischerweise einhergeht.

Für wen Rust ist

Rust ist für viele Menschen aus einer Vielzahl von Gründen ideal. Schauen wir uns einige der wichtigsten Nutzergruppen an.

Entwicklerteams

Rust erweist sich als produktives Werkzeug in der Zusammenarbeit großer Entwicklerteams mit unterschiedlichem Kenntnisstand in der Systemprogrammierung. Systemnaher Code ist anfällig für eine Vielzahl subtiler Fehler, die in den meisten anderen Sprachen nur durch ausgiebige Tests und sorgfältige Überprüfung des Codes durch erfahrene Entwickler erkannt werden können. In Rust spielt der Compiler eine Art Pförtnerrolle, indem er Code mit diesen schwer fassbaren Fehlern zu kompilieren verweigert, darunter auch Nebenläufigkeitsfehler. Mit der Arbeit an der Seite des Compilers kann sich das Team auf die Programmlogik konzentrieren, anstatt Fehler zu suchen.

Rust bringt auch zeitgemäße Entwicklerwerkzeuge in die Welt der Systemprogrammierung:

- Cargo, das mitgelieferte Abhängigkeitsmanagement- und Bau-Werkzeug, macht das Hinzufügen, Kompilieren und Verwalten von Abhängigkeiten im gesamten Rust-Ökosystem schmerzlos und konsistent.

- Das Formatierungstool

rustfmtsorgt für einen einheitlichen Codierstil bei den Entwicklern. - Der Rust-Sprachserver (Rust Language Server) ermöglicht Codevervollständigung und im Code angezeigte Fehlermeldungen innerhalb der Entwicklungsumgebung (IDE).

Durch den Einsatz dieser und anderer Werkzeuge des Rust-Ökosystems können Entwickler produktiv arbeiten, während sie Code auf Systemebene schreiben.

Studenten

Rust ist für Studenten und alle, die sich für Systemkonzepte interessieren. Mit Rust haben viele Menschen etwas über Themen wie die Entwicklung von Betriebssystemen gelernt. Die Gemeinschaft ist sehr einladend und beantwortet gerne Fragen der Studenten. Durch Bemühungen wie dieses Buch will das Rust-Team Systemkonzepte mehr Menschen zugänglich machen, insbesondere denen, die neu in der Programmierung sind.

Unternehmen

Hunderte von Unternehmen, große und kleine, setzen Rust für eine Vielzahl von Aufgaben in der Produktion ein, dazu gehören Kommandozeilenwerkzeuge, Webdienste, DevOps-Werkzeuge, eingebettete Geräte, Audio- und Videoanalyse und -transkodierung, Kryptowährungen, Bioinformatik, Suchmaschinen, Anwendungen für das Internet der Dinge, maschinelles Lernen und sogar wesentliche Teile des Webbrowsers Firefox.

Open-Source-Entwickler

Rust ist für Menschen, die die Programmiersprache Rust, die Gemeinschaft, Entwickler-Werkzeuge und Bibliotheken aufbauen möchten. Wir würden uns freuen, wenn du zur Programmiersprache Rust beiträgst.

Menschen, die Geschwindigkeit und Stabilität schätzen

Rust ist für Menschen, die sich nach Geschwindigkeit und Stabilität einer Sprache sehnen. Mit Geschwindigkeit meinen wir sowohl die Geschwindigkeit, mit der Rust-Code ausgeführt werden kann, als auch die Geschwindigkeit, mit der du mit Rust Programme schreiben kannst. Die Prüfungen des Rust-Compilers gewährleisten Stabilität, während du neue Funktionen hinzufügst und deinen Code änderst. Dies steht im Gegensatz zu brüchigen Code-Altlasten in Sprachen ohne diese Prüfungen, die Entwickler sich oft scheuen zu verändern. Durch das Streben nach kostenneutralen Abstraktionen, also Funktionalität auf höherer Ebene, die zu genauso schnellem Code wie manuell geschriebener Code auf niedrigerer Ebene kompiliert, bemüht sich Rust, sicheren Code auch zu schnellem Code zu machen.

Die Sprache Rust hofft, auch viele andere Nutzer zu unterstützen; die hier genannten sind nur einige der größten Interessensgruppen. Insgesamt ist es Rusts größtes Bestreben, den Zielkonflikt zu beseitigen, den die Programmierer jahrzehntelang hingenommen haben, wenn sie Sicherheit und Produktivität bzw. Geschwindigkeit und Ergonomie erreichen wollten. Versuche es mit Rust und finde heraus, ob dessen Möglichkeiten für dich geeignet sind.

Für wen dieses Buch gedacht ist

In diesem Buch wird davon ausgegangen, dass du bereits Code in einer anderen Programmiersprache geschrieben hast, es spielt aber keine Rolle, in welcher. Wir haben versucht, das Material einem breiten Publikum mit unterschiedlichem Programmierhintergrund zugänglich zu machen. Wir verbringen nicht viel Zeit damit, darüber zu sprechen, was Programmieren ist oder wie man darüber denkt. Wenn Programmieren für dich ganz neu ist, wäre es besser, wenn du ein Buch speziell zur Einführung in die Programmierung liest.

Wie man dieses Buch verwendet

Im Allgemeinen geht dieses Buch davon aus, dass du es der Reihe nach von vorne nach hinten liest. Spätere Kapitel bauen auf den Konzepten früherer Kapitel auf. Frühere Kapitel gehen möglicherweise nicht auf die Einzelheiten eines Themas ein, denn in der Regel werden wir es in einem späteren Kapitel erneut aufgreifen.

Du findest in diesem Buch zwei Kapitelarten: Konzeptkapitel und Projektkapitel. In Konzeptkapiteln erfährst du etwas über einen Aspekt von Rust. In Projektkapiteln schreiben wir gemeinsam kleine Programme und wenden das bisher Gelernte an. Die Kapitel 2, 12 und 21 sind Projektkapitel; die übrigen sind Konzeptkapitel.

Kapitel 1 erklärt, wie man Rust installiert, wie man ein „Hallo Welt“-Programm schreibt und wie man Cargo, den Paketmanager und das Bauwerkzeug von Rust, benutzt. Kapitel 2 ist eine praktische Einführung in die Sprache Rust. Hier werden Konzepte auf hohem Niveau behandelt, spätere Kapitel werden zusätzliche Einzelheiten liefern. Wenn du dir schon jetzt die Hände schmutzig machen willst, dann ist Kapitel 2 der richtige Ort dafür. Wenn du ein besonders akribischer Lerner bist, der es vorzieht, jedes Detail zu lernen, bevor er zum nächsten übergeht, solltest du vielleicht Kapitel 2 überspringen und direkt zu Kapitel 3 übergehen, das Rust-Funktionen behandelt, die denen anderer Programmiersprachen ähneln. Anschließend kannst du zu Kapitel 2 zurückkehren, wenn du an einem Projekt arbeiten möchtest, bei dem du die gelernten Details anwenden kannst.

In Kapitel 4 lernst du die Eigentümerschaft in Rust kennen.

Kapitel 5 bespricht Strukturen und Methoden, und Kapitel 6 behandelt

Aufzählungen, match-Ausdrücke und die Kontrollflusskonstrukte if let und

let...else. Du wirst Strukturen und Aufzählungen verwenden, um

benutzerdefinierte Typen zu erstellen.

In Kapitel 7 erfährst du mehr über das Modulsystem von Rust und über die Sichtbarkeitregeln zum Organisieren deines Codes und dessen öffentlich zugängliche Programmierschnittstelle (API). In Kapitel 8 werden einige gängige Kollektionsdatenstrukturen, die die Standardbibliothek zur Verfügung stellt, behandelt: Vektoren, Strings und Hashtabellen. Kapitel 9 befasst sich mit Rusts Philosophie und Techniken der Fehlerbehandlung.

Kapitel 10 vertieft generische Datentypen, Traits und Lebensdauern, die dir

die Möglichkeit geben, Code zu schreiben, der für mehrere Typen passt. In

Kapitel 11 dreht sich alles um das Testen, das selbst mit den

Sicherheitsgarantien von Rust erforderlich ist, um eine korrekte Logik deines

Programms sicherzustellen. In Kapitel 12 werden wir unsere eigene

Implementierung für eine Teilfunktionalität des Kommandozeilenwerkzeugs grep

schreiben, das nach Text in Dateien sucht. Dazu werden wir viele Konzepte

anwenden, die wir in den vorangegangenen Kapiteln kennengelernt haben.

Kapitel 13 befasst sich mit Closures und Iteratoren, also Sprachmerkmalen, die von funktionalen Programmiersprachen stammen. In Kapitel 14 werden wir einen genaueren Blick auf Cargo werfen und über bewährte Vorgehensweisen beim Bereitstellen deiner Bibliotheken für andere sprechen. In Kapitel 15 werden intelligente Zeiger, die die Standardbibliothek bereitstellt, und Traits, die ihre Funktionalität ermöglichen, erörtert.

In Kapitel 16 gehen wir durch verschiedene Modelle der nebenläufigen Programmierung und sprechen darüber, wie Rust dir hilft, furchtlos mit mehreren Threads zu programmieren. In Kapitel 17 bauen wir darauf auf, indem wir die async- und await-Syntax von Rust zusammen mit Aufgaben (tasks), Futures und Streams und dem leichtgewichtigen Nebenläufigkeitsmodell, das sie ermöglichen, untersuchen.

Kapitel 18 befasst sich mit dem Vergleich von Rust-Idiomen mit objektorientierten Programmierprinzipien, mit denen du vielleicht vertraut bist. Kapitel 19 ist ein Nachschlagewerk zu Muster und Pattern Matching, einem mächtigen Mittel zum Ausdrücken von Ideen in Rust-Programmen. Kapitel 20 enthält ein Sammelsurium an interessanten fortgeschrittenen Themen, darunter unsafe Rust, Makros und mehr zu Lebensdauer, Traits, Typen, Funktionen und Closures.

In Kapitel 21 werden wir ein Projekt abschließen, bei dem wir einen systemnahen, nebenläufigen Webdienst implementieren!

Schließlich enthalten einige Anhänge nützliche Informationen über die Sprache in einem eher referenzartigen Format. Anhang A enthält die Schlüsselwörter von Rust, Anhang B die Operatoren und Symbole von Rust, Anhang C ableitbare Traits, die von der Standardbibliothek mitgebracht werden, Anhang D nützliche Entwicklungswerkzeuge und Anhang E erläutert die Rust-Editionen. In Anhang F findest du Übersetzungen des Buches, und in Anhang G erfährst du, wie Rust erstellt wird und was nächtliches (nightly) Rust ist.

Es gibt keinen falschen Weg, dieses Buch zu lesen: Wenn du was überspringen willst, nur zu! Möglicherweise musst du zu früheren Kapiteln zurückkehren, wenn du irritiert bist. Aber tue, was immer für dich passt.

Ein wichtiger Teil beim Lernen von Rust ist das Verstehen der Fehlermeldungen, die der Compiler anzeigt: Diese leiten dich zum funktionierenden Code. Daher werden wir viele Beispiele bringen, die nicht kompilieren, zusammen mit der jeweiligen Fehlermeldung des Compilers. Wenn du also ein zufälliges Beispiel eingibst und ausführen willst, lässt es sich möglicherweise nicht kompilieren! Stelle sicher, dass du den umgebenden Text liest, um zu wissen, ob das Beispiel, das du ausführen willst, einen Fehler zeigen soll. In den meisten Fällen führen wir dich von einem Code, der nicht kompiliert, zur funktionierenden Codeversion. Ferris gibt dir einen Hinweis bei Code, der nicht funktionieren soll:

| Ferris | Bedeutung |

|---|---|

| Dieser Code lässt sich nicht kompilieren! | |

| Dieser Code bricht ab (panic)! | |

| Dieser Code liefert nicht das gewünschte Verhalten. |

In den meisten Situationen führen wir dich zu einer funktionierenden Codeversion, wenn er sich nicht kompilieren lässt.

Quellcode

Die Quelldateien, aus denen dieses Buch generiert wird, findest du unter GitHub.

Erste Schritte

Lass uns mit Rust loslegen! Es gibt viel zu lernen, aber irgendwo muss man bekanntlich anfangen. In diesem Kapitel geht es um folgende Themen:

- Installieren von Rust unter Linux, macOS und Windows

- Schreiben eines Programms, das

Hallo Welt!ausgibt - Verwenden von

cargo, Rusts Paketmanager und Bauwerkzeug

Installation

Installation

Der erste Schritt ist, Rust zu installieren. Wir werden Rust mittels rustup

herunterladen, einem Kommandozeilenwerkzeug für die Verwaltung von

Rust-Versionen und dazugehörigen Werkzeugen. Du wirst eine Internetverbindung

für den Download benötigen.

Anmerkung: Falls du

rustupaus irgendeinem Grund nicht verwenden möchtest, schaue bitte auf der Seite „Andere Rust-Installationsmethoden“ nach weiteren Möglichkeiten.

Die folgenden Schritte installieren die neueste stabile Version des Rust-Compilers. Rust garantiert Stabilität und stellt somit sicher, dass alle kompilierbaren Beispiele in diesem Buch auch mit neueren Rust-Versionen kompilierbar bleiben werden. Die Ausgabe der Beispiele kann sich zwischen Versionen leicht unterscheiden, weil Rust oft Fehlermeldungen und Warnungen verbessert. Anders ausgedrückt, jede neuere stabile Version von Rust, die du mithilfe dieser Schritte installierst, sollte wie erwartet mit dem Inhalt dieses Buchs funktionieren.

Kommandozeilen-Schreibweise

In diesem Kapitel und im ganzen Buch werden wir einige Befehle auf dem Terminal zeigen. Alle Zeilen, die du in das Terminal eingeben sollst, beginnen mit

$. Du brauchst das$-Zeichen nicht einzugeben; es weist nur auf den Beginn jedes Befehls hin. Zeilen, die nicht mit$beginnen, zeigen normalerweise die Ausgabe eines vorherigen Befehls. PowerShell-spezifische Beispiele verwenden außerdem>anstelle von$.

Installation von rustup unter Linux und macOS

Falls du Linux oder macOS verwendest, öffne ein Terminalfenster und gib den folgenden Befehl ein:

$ curl --proto '=https' --tlsv1.2 https://sh.rustup.rs -sSf | sh

Dieser Befehl lädt ein Skript herunter und startet die Installation

von rustup, welches die neueste stabile Version von Rust installiert.

Du wirst ggf. aufgefordert, dein Passwort einzugeben. Nach erfolgreicher

Installation erscheint folgende Zeile:

Rust is installed now. Great!

Außerdem benötigst du einen Linker (Programm-Binder), ein Programm, das Rust verwendet, um die kompilierten Dateien in eine Datei zusammenzuführen. Wahrscheinlich hast du bereits einen. Wenn du Linker-Fehler erhältst, solltest du einen C-Compiler installieren, der in der Regel auch einen Linker enthält. Ein C-Compiler ist auch deshalb nützlich, weil einige gängige Rust-Pakete von C-Code abhängen und daher einen C-Compiler benötigen.

Unter macOS erhältst du einen C-Compiler, indem du Folgendes ausführst:

$ xcode-select --install

Linux-Benutzer sollten in der Regel GCC oder Clang installieren, je nach

Dokumentation ihrer Distribution. Wenn du zum Beispiel Ubuntu verwendest,

kannst du das Paket build-essential installieren.

Installation von rustup unter Windows

Rufe https://www.rust-lang.org/tools/install auf und folge den Anweisungen, um Rust unter Windows zu installieren. Während der Installation wirst du aufgefordert, Visual Studio zu installieren. Dieses enthält einen Linker und die nativen Bibliotheken, die zum Kompilieren von Programmen benötigt werden. Wenn du an dieser Stelle weitere Hilfe brauchst, gehe zu https://rust-lang.github.io/rustup/installation/windows-msvc.html.

Der Rest dieses Buchs verwendet Befehle, die sowohl in cmd.exe als auch in der PowerShell funktionieren. Falls es spezifische Unterschiede geben sollte, werden wir diese erläutern.

Fehlersuche

Um zu überprüfen, ob du Rust korrekt installiert hast, öffne ein Terminal und gib folgende Zeile ein:

$ rustc --version

Du solltest die Versionsnummer, den Commit-Hash und das Commit-Datum für die letzte stabile Version, die veröffentlicht wurde, in folgendem Format sehen:

rustc x.y.z (abcabcabc jjjj-mm-tt)

Wenn du diese Information siehst, hast du Rust erfolgreich installiert! Wenn du

diese Information nicht siehst, überprüfe, ob Rust in deiner Systemvariable

%PATH% wie folgt enthalten ist.

In Windows CMD verwende:

> echo %PATH%

In PowerShell verwende:

> echo $env:Path

In Linux und macOS verwende:

$ echo $PATH

Wenn das alles korrekt ist und Rust immer noch nicht funktioniert, gibt es mehrere Stellen, an denen du Hilfe bekommen kannst. Wie du mit anderen Rust-Entwicklern in Kontakt treten kannst, erfährst du auf der Gemeinschafts-Seite.

Aktualisieren und Deinstallieren

Nachdem du Rust mithilfe von rustup installiert hast, ist es einfach, auf die

neueste Version zu aktualisieren. Führe folgenden Befehl im Terminal aus:

$ rustup update

Um Rust und rustup zu deinstallieren, führe folgenden Befehl aus:

$ rustup self uninstall

Lokale Dokumentation lesen

Die Rust-Installation enthält auch eine lokale Kopie der Dokumentation, sodass

du sie ohne Internetverbindung lesen kannst. Führe rustup doc aus, um die

lokale Dokumentation in deinem Browser zu öffnen.

Falls du dir nicht sicher bist, wie du einen Typ oder eine Funktion aus der Standardbibliothek verwenden sollst, dann schau in der API-Dokumentation nach!

Texteditoren und IDEs verwenden

Dieses Buch macht keine Annahmen darüber, welche Werkzeuge du für die Erstellung von Rust-Code verwendest. So gut wie jeder Texteditor ist dafür ausreichend! Viele Texteditoren und integrierte Entwicklungsumgebungen (IDEs) haben jedoch integrierte Unterstützung für Rust. Eine aktuelle Liste von Editoren und IDEs findest du auf der Tools-Seite der Rust-Website.

Offline mit diesem Buch arbeiten

In mehreren Beispielen werden wir Rust-Pakete außerhalb der Standardbibliothek

verwenden. Um diese Beispiele durchzuarbeiten, benötigst du entweder eine

Internetverbindung oder du musst diese Abhängigkeiten im Voraus heruntergeladen

haben. Um die Abhängigkeiten im Voraus herunterzuladen, kannst du die folgenden

Befehle ausführen. (Wir werden später im Detail erklären, was cargo ist und

was jeder dieser Befehle tut.)

$ cargo new get-dependencies

$ cd get-dependencies

$ cargo add rand@0.8.5 trpl@0.2.0

Dadurch werden die Downloads für diese Pakete zwischengespeichert, sodass du

sie später nicht erneut herunterladen musst. Sobald du diesen Befehl ausgeführt

hast, musst du den Ordner get-dependencies nicht mehr behalten. Wenn du

diesen Befehl ausgeführt hast, kannst du den Parameter --offline mit allen

cargo-Befehlen im Rest des Buches verwenden, um diese zwischengespeicherten

Versionen zu verwenden, anstatt sie aus dem Internet zu holen.

Hallo Welt

Hallo Welt

Nachdem du Rust installiert hast, lass uns dein erstes Rust-Programm schreiben.

Wenn man eine neue Sprache lernt, ist es üblich, ein kleines Programm zu

schreiben, das den Text Hallo Welt! auf dem Bildschirm ausgibt, also werden

wir hier dasselbe tun!

Hinweis: Dieses Buch setzt grundlegende Vertrautheit mit der Kommandozeile voraus. Rust stellt keine besonderen Anforderungen an deine Textbearbeitung oder Werkzeuge oder an den Ort, an dem dein Code lebt. Wenn du also lieber eine IDE statt der Kommandozeile verwenden möchtest, kannst du deine bevorzugte IDE verwenden. Viele IDEs bieten mittlerweile einen gewissen Grad an Rust-Unterstützung; Einzelheiten findest du in der Dokumentation der IDE. Das Rust-Team hat sich darauf konzentriert, eine großartige IDE-Unterstützung mittels

rust-analyzerzu ermöglichen. Siehe Anhang D für weitere Details.

Projektverzeichnis aufsetzen

Du beginnst damit, ein Verzeichnis zum Speichern deines Rust-Codes zu erstellen. Es ist Rust egal, wo dein Code lebt, aber für die Übungen und Projekte in diesem Buch schlagen wir vor, ein Verzeichnis projects in deinem Hauptverzeichnis anzulegen und all deine Projekte dort abzulegen.

Öffne ein Terminal und gib die folgenden Befehle ein, um ein Verzeichnis projects und ein Verzeichnis für das Projekt „Hallo Welt!“ innerhalb des Verzeichnisses projects zu erstellen.

Gib dies bei Linux, macOS und PowerShell unter Windows ein:

$ mkdir ~/projects

$ cd ~/projects

$ mkdir hello_world

$ cd hello_world

Bei Windows CMD gib dies ein:

> mkdir "%USERPROFILE%\projects"

> cd /d "%USERPROFILE%\projects"

> mkdir hello_world

> cd hello_world

Grundlagen eines Rust-Programms

Als nächstes erstelle eine neue Quelldatei und nenne sie main.rs. Rust-Dateien enden immer mit der Erweiterung .rs. Wenn du mehr als ein Wort in deinem Dateinamen verwendest, verwende einen Unterstrich, um sie zu trennen. Verwende zum Beispiel hello_world.rs statt helloworld.rs.

Öffne nun die Datei main.rs, die du gerade erstellt hast, und gib den Code in Listing 1-1 ein.

Dateiname: main.rs

fn main() {

println!("Hallo Welt!");

}Listing 1-1: Ein Programm, das Hallo Welt!

ausgibt

Speichere die Datei und gehe zurück zu deinem Terminalfenster im Verzeichnis ~/projects/hello_world. Gib unter Linux oder macOS die folgenden Befehle ein, um die Datei zu kompilieren und auszuführen:

$ rustc main.rs

$ ./main

Hallo Welt!

Unter Windows gib den Befehl .\main anstelle von ./main ein:

> rustc main.rs

> .\main

Hallo Welt!

Unabhängig von deinem Betriebssystem sollte der String Hallo Welt! im Terminal

ausgegeben werden. Wenn du diese Ausgabe nicht siehst, lies im Abschnitt

„Fehlersuche“ des Installationsabschnitts nach, wie du Hilfe

erhalten kannst.

Wenn Hallo Welt! ausgegeben wurde, herzlichen Glückwunsch! Du hast offiziell

ein Rust-Programm geschrieben. Das macht dich zu einem Rust-Programmierer

– willkommen!

Die Anatomie eines Rust-Programms

Lass uns im Detail anschauen, was gerade in deinem „Hallo Welt!“-Programm passiert ist. Hier ist das erste Teil des Puzzles:

fn main() {

}Diese Zeilen definieren eine Funktion namens main in Rust. Die Funktion main

ist eine Besonderheit: Sie ist immer der erste Code, der in jedem ausführbaren

Rust-Programm ausgeführt wird. In diesem Fall deklariert die erste Zeile eine

Funktion mit dem Namen main, die keine Parameter hat und nichts zurückgibt.

Wenn es Parameter gäbe, würden sie innerhalb der Klammern () stehen.

Der Funktionsrumpf ist in geschweifte Klammern {} eingehüllt. Rust erfordert

diese für alle Funktionsrümpfe. Es ist guter Stil, die öffnende geschweifte

Klammer in dieselbe Zeile wie die Funktionsdeklaration zu platzieren und

dazwischen ein Leerzeichen einzufügen.

Hinweis: Wenn du einen Standardstil für alle Rust-Projekte verwenden möchtest, kannst du ein automatisches Formatierungswerkzeug namens

rustfmtverwenden, um deinen Code in einem bestimmten Stil zu formatieren (mehr überrustfmtim Anhang D). Das Rust-Team hat dieses Tool wierustcin die Standard-Rust-Distribution aufgenommen, es sollte also bereits auf deinem Computer installiert sein!

Innerhalb der Funktion main befindet sich der folgende Code:

#![allow(unused)]

fn main() {

println!("Hallo Welt!");

}Diese Zeile erledigt die ganze Arbeit in diesem kleinen Programm: Sie gibt Text auf dem Bildschirm aus. Hier gibt es drei wichtige Details zu beachten.

Erstens ruft println! ein Rust-Makro auf. Wenn es stattdessen eine Funktion

aufrufte, würde diese als println (ohne !) angegeben werden. Rust-Makros

sind eine Möglichkeit, Code zu schreiben, der Code zur Erweiterung der

Rust-Syntax generiert. Wir werden sie in Kapitel 20 näher

erläutern. Im Moment musst du nur wissen, dass die Verwendung eines !

bedeutet, dass du ein Makro anstelle einer normalen Funktion aufrufst und dass

Makros nicht immer denselben Regeln folgen wie Funktionen.

Zweitens siehst du den String "Hallo Welt!". Wir übergeben diesen String als

Argument an println!, und er wird auf dem Bildschirm ausgegeben.

Drittens beenden wir die Zeile mit einem Semikolon (;), was anzeigt, dass

dieser Ausdruck beendet ist und der nächste beginnen kann. Die meisten Zeilen

eines Rust-Codes enden mit einem Semikolon.

Kompilierung und Ausführung

Du hast gerade ein neu erstelltes Programm ausgeführt, also lass uns jeden Schritt in diesem Prozess untersuchen.

Bevor du ein Rust-Programm ausführst, musst du es mit dem Rust-Compiler

kompilieren, indem du den Befehl rustc eingibst und ihm den Namen deiner

Quelldatei übergibst, so wie hier:

$ rustc main.rs

Wenn du einen C- oder C++-Hintergrund hast, wirst du feststellen, dass dies

ähnlich wie gcc oder clang ist. Nach erfolgreicher Kompilierung gibt Rust

eine ausführbare Binärdatei aus.

Unter Linux, macOS und PowerShell unter Windows kannst du die ausführbare Datei

sehen, indem du den Befehl ls in deinem Terminal eingibst:

$ ls

main main.rs

Unter Linux und macOS siehst du zwei Dateien. Mit PowerShell unter Windows siehst du die gleichen drei Dateien, die du mit CMD sehen würdest. Bei CMD unter Windows würdest du Folgendes eingeben:

> dir /B %= die Option /B bewirkt, dass nur die Dateinamen angezeigt werden =%

main.exe

main.pdb

main.rs

Dies zeigt die Quellcodedatei mit der Erweiterung .rs, die ausführbare Datei (main.exe unter Windows, aber main auf allen anderen Plattformen) und, bei Verwendung von Windows, eine Datei mit Debugging-Informationen mit der Erweiterung .pdb. Von hier aus führst du die Datei main oder main.exe aus, so wie hier:

$ ./main # oder .\main unter Windows

Wenn main.rs dein „Hallo Welt!“-Programm wäre, würde diese Zeile „Hallo Welt!“ in deinem Terminal ausgeben.

Wenn du mit einer dynamischen Sprache wie Ruby, Python oder JavaScript besser vertraut bist, bist du es möglicherweise nicht gewohnt, ein Programm in getrennten Schritten zu kompilieren und auszuführen. Rust ist eine vorab kompilierte (ahead-of-time compiled) Sprache, d.h. du kannst ein Programm kompilieren und die ausführbare Datei an jemand anderen weitergeben, und dieser kann das Programm auch ohne Installation von Rust ausführen. Wenn du jemandem eine .rb-, .py- oder .js-Datei gibst, muss er eine Ruby-, Python- bzw. JavaScript-Implementierung installiert haben. Aber in diesen Sprachen benötigst du nur einen Befehl, um dein Programm zu kompilieren und auszuführen. Beim Sprachdesign ist alles ein Kompromiss.

Einfach mit rustc zu kompilieren ist für einfache Programme in Ordnung, aber

wenn dein Projekt wächst, wirst du alle Optionen verwalten und es einfach

machen wollen, deinen Code weiterzugeben. Als Nächstes stellen wir dir das

Cargo-Tool vor, das dir beim Schreiben von Rust-Programmen aus der realen Welt

helfen wird.

Hallo Cargo

Hallo Cargo

Cargo ist das Bau-System (build system) und der Paketmanager von Rust. Die meisten Rust-Entwickler verwenden dieses Werkzeug, um ihre Rust-Projekte zu verwalten, weil Cargo viele Aufgaben für dich erledigt, z.B. das Bauen deines Codes, Herunterladen der Bibliotheken, von denen dein Code abhängt, und das Bauen dieser Bibliotheken. (Wir nennen Bibliotheken, die dein Code benötigt, Abhängigkeiten (dependencies).)

Die einfachsten Rust-Programme, wie das, das wir bisher geschrieben haben, haben keine Abhängigkeiten. Wenn wir also das „Hallo Welt!“-Projekt mit Cargo gebaut hätten, würde es nur den Teil von Cargo verwenden, der für das Bauen deines Codes zuständig ist. Wenn du komplexere Rust-Programme schreibst, wirst du Abhängigkeiten hinzufügen, und wenn du ein Projekt mit Cargo beginnst, wird das Hinzufügen von Abhängigkeiten viel einfacher sein.

Da die überwiegende Mehrheit der Rust-Projekte Cargo verwendet, geht der Rest dieses Buches davon aus, dass auch du Cargo verwendest. Cargo wird mit Rust installiert, wenn du die offiziellen Installationsprogramme verwendet hast, die im Abschnitt „Installation“ besprochen werden. Wenn du Rust auf eine andere Weise installiert hast, prüfe, ob Cargo installiert ist, indem du Folgendes in dein Terminal eingibst:

$ cargo --version

Wenn du eine Versionsnummer siehst, hast du es! Wenn du einen Fehler siehst,

z.B. command not found, schaue in der Dokumentation zu deiner

Installationsmethode nach, um festzustellen, wie du Cargo separat installieren

kannst.

Projekt mit Cargo erstellen

Lass uns mit Cargo ein neues Projekt erstellen und uns ansehen, wie es sich von unserem ursprünglichen „Hallo Welt!“-Projekt unterscheidet. Navigiere zurück zu deinem projects-Verzeichnis (oder wo auch immer du dich entschieden hast, deinen Code zu speichern). Führe dann auf einem beliebigen Betriebssystem die folgenden Schritte aus:

$ cargo new hello_cargo

$ cd hello_cargo

Der erste Befehl erstellt ein neues Verzeichnis und ein Projekt namens hello_cargo. Wir haben unser Projekt hello_cargo genannt und Cargo erstellt seine Dateien in einem Verzeichnis mit demselben Namen.

Gehe in das Verzeichnis hello_cargo und liste die Dateien auf. Du wirst sehen, dass Cargo zwei Dateien und ein Verzeichnis für uns generiert hat: Eine Datei Cargo.toml und ein Verzeichnis src mit einer Datei main.rs darin.

Es hat auch ein neues Git-Repository zusammen mit einer Datei .gitignore

initialisiert. Git-Dateien werden nicht erzeugt, wenn du cargo new innerhalb

eines existierenden Git-Repositories ausführst; du kannst dieses Verhalten

überschreiben, indem du cargo new --vcs=git verwendest.

Hinweis: Git ist ein gebräuchliches Versionskontrollsystem. Du kannst

cargo newanpassen, um ein anderes Versionskontrollsystem oder kein Versionskontrollsystem zu verwenden, indem du das Flag--vcsverwendest. Führecargo new --helpaus, um die verfügbaren Optionen zu sehen.

Öffne Cargo.toml in einem Texteditor deiner Wahl. Es sollte ähnlich wie der Code in Listing 1-2 aussehen.

Dateiname: Cargo.toml

[package]

name = "hello_cargo"

version = "0.1.0"

edition = "2024"

[dependencies]

Listing 1-2: Inhalt von Cargo.toml erzeugt durch

cargo new

Diese Datei liegt im Format TOML (Tom’s Obvious, Minimal Language) vor, welches das Konfigurationsformat von Cargo ist.

Die erste Zeile [package] ist eine Abschnittsüberschrift, die anzeigt, dass

die folgenden Anweisungen ein Paket konfigurieren. Wenn wir weitere

Informationen zu dieser Datei hinzufügen, werden wir weitere Abschnitte

hinzufügen.

Die nächsten drei Zeilen legen die Konfigurationsinformationen fest, die Cargo

benötigt, um dein Programm zu kompilieren: Den Namen, die Version und die zu

verwendende Rust-Edition. Über den Schlüssel edition sprechen wir in Anhang

E.

Die letzte Zeile [dependencies] ist der Anfang eines Abschnitts, in dem du

alle Abhängigkeiten deines Projekts auflisten kannst. In Rust werden Codepakete

als Crates (Kisten) bezeichnet. Wir werden keine anderen Crates für dieses

Projekt benötigen, aber wir werden es im ersten Projekt in Kapitel 2 tun, also

werden wir dann diesen Abhängigkeits-Abschnitt verwenden.

Öffne nun src/main.rs und wirf einen Blick darauf:

Dateiname: src/main.rs

fn main() {

println!("Hello, world!");

}Cargo hat für dich ein „Hello, world!“-Programm generiert, genau wie das, das wir in Listing 1-1 geschrieben haben! Die Unterschiede zwischen unserem Projekt und dem Projekt, das Cargo generiert hat, bestehen bisher darin, dass Cargo den Code im Verzeichnis src abgelegt hat, und wir haben eine Konfigurationsdatei Cargo.toml im obersten Verzeichnis.

Cargo erwartet, dass deine Quelldateien innerhalb des src-Verzeichnisses liegen. Das Projektverzeichnis der obersten Ebene ist nur für README-Dateien, Lizenzinformationen, Konfigurationsdateien und alles andere, was nicht mit deinem Code zusammenhängt. Das Verwenden von Cargo hilft dir, deine Projekte zu organisieren. Es gibt einen Platz für alles und alles ist an seinem Platz.

Wenn du ein Projekt begonnen hast, das Cargo nicht verwendet, wie wir es mit

dem Projekt „Hallo Welt!“ getan haben, kannst du es in ein Projekt umwandeln,

das Cargo verwendet. Verschiebe den Projektcode in das Verzeichnis src und

erstelle eine entsprechende Cargo.toml-Datei. Eine einfache Möglichkeit, die

Datei Cargo.toml zu erstellen, besteht darin, cargo init auszuführen.

Bauen und Ausführen eines Cargo-Projekts

Schauen wir uns nun an, was anders ist, wenn wir das „Hello, world!“-Programm mit Cargo bauen und ausführen. Von deinem hello_cargo-Verzeichnis aus baust du dein Projekt, indem du den folgenden Befehl eingibst:

$ cargo build

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 2.85 secs

Dieser Befehl erzeugt eine ausführbare Datei in target/debug/hello_cargo (oder target\debug\hello_cargo.exe unter Windows) und nicht in deinem aktuellen Verzeichnis. Da standardmäßig für den Debug-Modus gebaut wird, legt Cargo die Binärdatei in einem Verzeichnis namens debug ab. Mit diesem Befehl kannst du die ausführbare Datei ausführen:

$ ./target/debug/hello_cargo # oder .\target\debug\hello_cargo.exe unter Windows

Hello, world!

Wenn alles gut geht, sollte Hello, world! im Terminal ausgegeben werden. Wenn

cargo build zum ersten Mal ausgeführt wird, erzeugt Cargo auch eine neue

Datei auf der obersten Ebene: Cargo.lock. Diese Datei verfolgt die genauen

Versionen der Abhängigkeiten in deinem Projekt. Dieses Projekt hat keine

Abhängigkeiten, daher ist die Datei etwas spärlich. Du musst diese Datei

niemals manuell ändern; Cargo verwaltet ihren Inhalt für dich.

Wir haben gerade ein Projekt mit cargo build gebaut und es mit

./target/debug/hello_cargo ausgeführt, aber wir können auch cargo run

verwenden, um den Code zu kompilieren und dann die resultierende ausführbare

Datei mit einem einzigen Befehl auszuführen:

$ cargo run

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.0 secs

Running `target/debug/hello_cargo`

Hello, world!

Das Verwenden von cargo run ist bequemer, als sich daran erinnern zu müssen,

cargo build auszuführen und dann den gesamten Pfad zur Binärdatei zu

verwenden, daher verwenden die meisten Entwickler cargo run.

Beachte, dass wir diesmal keine Ausgabe gesehen haben, die darauf hinweist,

dass Cargo hello_cargo kompiliert hat. Cargo fand heraus, dass sich die

Dateien nicht geändert hatten, also hat es nicht neu gebaut, sondern ließ

einfach die Binärdatei laufen. Wenn du deinen Quellcode geändert hättest, hätte

Cargo das Projekt vor der Ausführung neu kompiliert, und du hättest diese

Ausgabe gesehen:

$ cargo run

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.33 secs

Running `target/debug/hello_cargo`

Hello, world!

Cargo bietet auch einen Befehl namens cargo check. Dieser Befehl überprüft

schnell deinen Code, um sicherzustellen, dass er kompiliert, erzeugt aber keine

ausführbare Datei:

$ cargo check

Checking hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.32 secs

Warum willst du keine ausführbare Datei? Häufig ist cargo check viel

schneller als cargo build, weil es den Schritt der Erstellung einer

ausführbaren Datei überspringt. Wenn du deine Arbeit während des Schreibens des

Codes ständig überprüfst, wird das Verwenden von cargo check den Prozess

beschleunigen! Daher führen viele Rust-Entwickler während des Schreibens ihres

Programms regelmäßig cargo check aus, um sicherzustellen, dass das Programm

kompiliert. Dann lassen sie cargo build laufen, wenn sie bereit sind, die

ausführbare Datei zu benutzen.

Lass uns zusammenfassen, was wir bisher über Cargo gelernt haben:

- Wir können ein Projekt mit

cargo newerstellen. - Wir können ein Projekt mit

cargo buildbauen. - Wir können ein Projekt mit

cargo runin einem Schritt bauen und ausführen. - Wir können ein Projekt mit

cargo checkbauen, ohne eine Binärdatei zu erzeugen, um auf Fehler zu prüfen. - Anstatt das Ergebnis des Bauvorgangs im selben Verzeichnis wie unser Code abzulegen, legt Cargo es im Verzeichnis target/debug ab.

Ein zusätzlicher Vorteil der Verwendung von Cargo ist, dass die Befehle unabhängig vom Betriebssystem sind, mit dem du arbeitest. Daher werden wir an dieser Stelle keine spezifischen Anweisungen für Linux und macOS gegenüber Windows mehr geben.

Bauen einer Freigabe (release)

Wenn dein Projekt schließlich zur Freigabe bereit ist, kannst du cargo build --release verwenden, um es mit Optimierungen zu kompilieren. Dieser Befehl

erzeugt eine ausführbare Datei in target/release anstelle von target/debug.

Durch die Optimierungen läuft dein Rust-Code schneller, aber wenn du sie

einschaltest, verlängert sich die Zeit, die dein Programm zum Kompilieren

benötigt. Aus diesem Grund gibt es zwei verschiedene Profile: Eines für die

Entwicklung, wenn du schnell und oft neu bauen willst, und ein anderes für das

Erstellen des endgültigen Programms, das du einem Benutzer gibst, das nicht

wiederholt neu gebaut wird und das so schnell wie möglich läuft. Wenn du einen

Laufzeit-Benchmark deines Codes durchführst, stelle sicher, dass du cargo build --release ausführst und den Benchmark mit der ausführbaren Datei in

target/release durchführst.

Konventionen von Cargo nutzen

Bei einfachen Projekten bietet Cargo nicht viel mehr Wert als das bloße

Verwenden von rustc, aber es wird sich in dem Maße bewähren, wie deine

Programme immer komplizierter werden. Sobald Programme auf mehrere Dateien

anwachsen oder eine Abhängigkeit benötigen, ist es viel einfacher, Cargo den

Bauvorgang koordinieren zu lassen.

Auch wenn das Projekt hello_cargo einfach ist, so verwendet es jetzt einen

Großteil der realen Werkzeuge, die du im Rest deiner Rust-Karriere verwenden

wirst. Tatsächlich kannst du, um an bestehenden Projekten zu arbeiten, die

folgenden Befehle verwenden, um den Code mit Git auszuchecken, in das

Verzeichnis dieses Projekts zu wechseln und zu bauen:

$ git clone example.org/someproject

$ cd someproject

$ cargo build

Weitere Informationen über Cargo findest du in seiner Dokumentation.

Zusammenfassung

Du hast deine Rust-Reise bereits gut begonnen! In diesem Kapitel hast du gelernt, wie es geht:

- Installiere die neueste stabile Version von Rust mit

rustup. - Aktualisiere auf eine neuere Rust-Version.

- Öffne die lokal installierte Dokumentation.

- Schreibe und führe ein „Hallo Welt!“-Programm aus, direkt mittels

rustc. - Schreibe und führe ein neues Projekt aus mittels Cargo-Konventionen.

Dies ist ein guter Zeitpunkt, ein umfangreicheres Programm zu erstellen, um dich an das Lesen und Schreiben von Rust-Code zu gewöhnen. In Kapitel 2 werden wir also ein Ratespielprogramm erstellen. Wenn du lieber damit beginnen möchtest, zu lernen, wie gängige Programmierkonzepte in Rust funktionieren, lies Kapitel 3 und kehre dann zu Kapitel 2 zurück.

Ein Ratespiel programmieren

Lass uns den Sprung in Rust wagen, indem wir gemeinsam ein praktisches Projekt

durcharbeiten! Dieses Kapitel führt dich in einige gängige Rust-Konzepte ein,

indem es dir zeigt, wie du diese in einem realen Programm verwenden kannst. Du

lernst let, match, Methoden, assoziierte Funktionen, externe Crates und mehr

kennen! In den folgenden Kapiteln werden wir diese Ideen ausführlicher

behandeln. In diesem Kapitel wirst du nur die Grundlagen üben.

Wir werden ein klassisches Programmierproblem für Anfänger implementieren: Ein Ratespiel. Und so funktioniert es: Das Programm erzeugt eine zufällige ganze Zahl zwischen 1 und 100. Dann wird es den Spieler auffordern, eine Schätzung einzugeben. Nachdem eine Schätzung eingegeben wurde, zeigt das Programm an, ob die Schätzung zu niedrig oder zu hoch ist. Wenn die Schätzung korrekt ist, gibt das Spiel eine Glückwunschnachricht aus und beendet sich.

Aufsetzen eines neuen Projekts

Um ein neues Projekt aufzusetzen, gehe in das Verzeichnis projects, das du in Kapitel 1 erstellt hast, und erstelle ein neues Projekt mit Cargo, wie folgt:

$ cargo new guessing_game

$ cd guessing_game

Der erste Befehl cargo new nimmt den Namen des Projekts (guessing_game) als

erstes Argument. Der zweite Befehl wechselt in das Verzeichnis des neuen

Projekts.

Schaue dir die generierte Datei Cargo.toml an:

Dateiname: Cargo.toml

[package]

name = "guessing_game"

version = "0.1.0"

edition = "2024"

[dependencies]

Wie du in Kapitel 1 gesehen hast, generiert cargo new ein „Hello,

world!“-Programm für dich. Sieh dir die Datei src/main.rs an:

Dateiname: src/main.rs

fn main() {

println!("Hello, world!");

}Kompilieren wir nun dieses „Hello, world!“-Programm und führen es im gleichen

Schritt aus mit dem Befehl cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 1.50s

Running `target/debug/guessing_game`

Hello, world!

Der Befehl run ist praktisch, wenn du ein Projekt schnell iterieren musst,

wie wir es in diesem Spiel tun werden, indem du jede Iteration schnell testest,

bevor du zur nächsten übergehst.

Öffne die Datei src/main.rs erneut. Du wirst den gesamten Code in diese Datei schreiben.

Verarbeiten einer Schätzung

Der erste Teil des Ratespielprogramms fragt nach einer Benutzereingabe, verarbeitet diese Eingabe und überprüft, ob die Eingabe in der erwarteten Form vorliegt. Zu Beginn erlauben wir dem Spieler, eine Schätzung einzugeben. Gib den Code aus Listing 2-1 in src/main.rs ein.

Dateiname: src/main.rs

use std::io;

fn main() {

println!("Rate die Zahl!");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Listing 2-1: Code, der eine Schätzung vom Benutzer erhält und ausgibt

Dieser Code enthält eine Menge Informationen, also gehen wir ihn Zeile für

Zeile durch. Um eine Benutzereingabe zu erhalten und das Ergebnis dann als

Ausgabe auszugeben, müssen wir die Bibliothek io (input/output) in den

Gültigkeitsbereich bringen. Die io-Bibliothek stammt aus der

Standardbibliothek, bekannt als std:

use std::io;

fn main() {

println!("Rate die Zahl!");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Standardmäßig hat Rust einige Elemente in der Standardbibliothek definiert, die es in den Gültigkeitsbereich jedes Programms bringt. Diese Menge wird Prelude genannt, und du kannst deren Inhalt in der Dokumentation der Standardbibliothek sehen.

Wenn ein Typ, den du verwenden willst, nicht im Prelude enthalten ist, musst du

diesen Typ explizit mit einer use-Anweisung in den Gültigkeitsbereich bringen.

Das Verwenden der Bibliothek std::io bietet dir eine Reihe von nützlichen

Funktionalitäten, einschließlich der Möglichkeit, Benutzereingaben

entgegenzunehmen.

Wie du in Kapitel 1 gesehen hast, ist die Funktion main der Einstiegspunkt in

das Programm:

use std::io;

fn main() {

println!("Rate die Zahl!");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Die Syntax fn deklariert eine neue Funktion; die Klammern () zeigen an,

dass es keine Parameter gibt; und die geschweifte Klammer { beginnt den Rumpf

der Funktion.

Wie du auch in Kapitel 1 gelernt hast, ist println! ein Makro, das einen

String auf dem Bildschirm ausgibt:

use std::io;

fn main() {

println!("Rate die Zahl!");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Dieser Code gibt eine Eingabeaufforderung aus, die angibt, um was für ein Spiel es sich handelt, und den Benutzer zur Eingabe auffordert.

Speichern von Werten mit Variablen

Als Nächstes erstellen wir eine Variable, um die Benutzereingabe zu speichern, wie hier:

use std::io;

fn main() {

println!("Rate die Zahl!");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Jetzt wird das Programm interessant! Es ist viel los in dieser kleinen Zeile.

Wir verwenden eine let-Anweisung, um eine Variable zu erzeugen. Hier ist ein

weiteres Beispiel:

let apples = 5;Diese Zeile erzeugt eine neue Variable namens apples und bindet sie an den

Wert 5. In Rust sind Variablen standardmäßig unveränderbar (immutable), das

heißt, sobald wir der Variablen einen Wert gegeben haben, wird sich der Wert

nicht mehr ändern. Wir werden dieses Konzept im Abschnitt „Variablen und

Veränderbarkeit“ in Kapitel 3 ausführlich

besprechen. Um eine Variable veränderbar zu machen, ergänzen wir mut vor dem

Variablennamen:

#![allow(unused)]

fn main() {

let apples = 5; // unveränderbar

let mut bananas = 5; // veränderbar

}Anmerkung: Die Syntax

//beginnt einen Kommentar, der bis zum Ende der Zeile weitergeht. Rust ignoriert alles in Kommentaren. Diese werden in Kapitel 3 ausführlicher besprochen.

Zurück zum Programm des Ratespiels. Du weißt jetzt, dass let mut guess eine

veränderbare Variable namens guess einführt. Das Gleichheitszeichen (=) sagt

Rust, dass wir jetzt etwas an die Variable binden wollen. Auf der rechten Seite

des Gleichheitszeichens steht der Wert, an den guess gebunden ist, was das

Ergebnis des Aufrufs von String::new ist, einer Funktion, die eine neue

Instanz eines String zurückgibt. String ist ein von der

Standardbibliothek bereitgestellter String-Typ, der ein wachstumsfähiges,

UTF-8-kodiertes Stück Text ist.

Die Syntax :: in der Zeile String::new zeigt an, dass new eine assoziierte

Funktion (associated function) vom Typ String ist. Eine assoziierte Funktion

ist eine Funktion, die auf einem Typ, in diesem Fall String, implementiert

ist. Diese Funktion new erzeugt einen neuen, leeren String. Du wirst eine

Funktion new bei vielen Typen finden, weil es ein gebräuchlicher Name für eine

Funktion ist, die einen neuen Wert irgendeiner Art erzeugt.

Insgesamt hat die Zeile let mut guess = String::new(); eine veränderbare

Variable erzeugt, die derzeit an eine neue, leere Instanz eines String

gebunden ist. Uff!

Empfangen von Benutzereingaben

Erinnere dich, dass wir die Ein-/Ausgabefunktionalität aus der

Standardbibliothek mit use std::io; in der ersten Zeile des Programms

eingebunden haben. Jetzt rufen wir die Funktion stdin aus dem Modul io auf,

die es uns ermöglichen wird, Benutzereingaben zu verarbeiten.

use std::io;

fn main() {

println!("Rate die Zahl!");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Hätten wir das Modul io nicht am Anfang des Programms mit use std::io;

importiert, könnten wir die Funktion trotzdem verwenden, indem wir den

Funktionsaufruf als std::io::stdin schreiben. Die Funktion stdin gibt eine

Instanz von std::io::Stdin zurück, was ein Typ ist, der eine

Standardeingaberessource (handle to the standard input) für dein Terminal

darstellt.

Die nächste Zeile .read_line(&mut guess) ruft die Methode

read_line der Standardeingaberessource auf, um eine Eingabe vom

Benutzer zu erhalten. Wir übergeben auch das Argument &mut guess an

read_line, um ihm mitzuteilen, in welchen String es die Benutzereingabe

speichern soll. Die Aufgabe von read_line ist es, alles, was der Benutzer in

die Standardeingabe eingibt, an einen String anzuhängen (ohne dessen Inhalt zu

überschreiben), daher übergeben wir diesen String als Argument. Das

String-Argument muss veränderbar sein, damit die Methode den Inhalt des Strings

ändern kann.

Das & zeigt an, dass es sich bei diesem Argument um eine Referenz handelt,

die dir eine Möglichkeit bietet, mehrere Teile deines Codes auf einen Datenteil

zugreifen zu lassen, ohne dass du diese Daten mehrfach in den Speicher kopieren

musst. Referenzen sind eine komplexe Funktionalität, und einer der

Hauptvorteile von Rust ist, wie sicher und einfach es ist, Referenzen zu

verwenden. Du musst nicht viele dieser Details kennen, um dieses Programm

fertigzustellen. Im Moment musst du nur wissen, dass Referenzen wie Variablen

standardmäßig unveränderbar sind. Daher musst du &mut guess anstatt &guess

schreiben, um sie veränderbar zu machen. (In Kapitel 4 werden Referenzen

ausführlicher erklärt.)

Behandeln potentieller Fehler mit Result

Wir arbeiten noch immer an dieser Codezeile. Wir besprechen jetzt eine dritte Textzeile, aber beachte, dass sie immer noch Teil einer einzigen logischen Codezeile ist. Der nächste Teil ist diese Methode:

use std::io;

fn main() {

println!("Rate die Zahl!");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Wir hätten diesen Code auch so schreiben können:

io::stdin().read_line(&mut guess).expect("Fehler beim Lesen der Zeile");Eine lange Zeile ist jedoch schwer zu lesen, daher ist es am besten, sie

aufzuteilen. Es ist oft ratsam, einen Zeilenumbruch und andere Leerzeichen

einzufügen, um lange Zeilen aufzubrechen, wenn du eine Methode mit der

Syntax .method_name() aufrufst. Lass uns nun besprechen, was diese Zeile

bewirkt.

Wie bereits erwähnt, schreibt read_line die Benutzereingabe in die übergebene

String-Variable, gibt aber darüber hinaus auch einen Result-Wert zurück.

Result ist eine Aufzählung (enumeration, oder kurz enum),

die einen Datentyp darstellt, der einem von mehreren möglichen Zuständen

annehmen kann. Wir nennen jeden möglichen Zustand eine Variante.

In Kapitel 6 werden Aufzählungen ausführlicher behandelt. Der Zweck

dieser Result-Typen ist es, Informationen zur Fehlerbehandlung zu kodieren.

Die Varianten von Result sind Ok und Err. Die Variante Ok gibt an, dass

die Operation erfolgreich war, und enthält den erfolgreich generierten Wert.

Die Variante Err bedeutet, dass die Operation fehlgeschlagen ist, und enthält

Informationen darüber, wie oder warum die Operation fehlgeschlagen ist.

Für Werte vom Typ Result sind, wie für Werte jedes Typs, Methoden definiert.

Eine Instanz von Result hat eine Methode expect, die du aufrufen

kannst. Wenn diese io::Result-Instanz ein Err-Wert ist, wird expect das

Programm abbrechen und die Meldung anzeigen, die du als Argument an expect

übergeben hast. Wenn die Methode read_line ein Err zurückgibt, ist dies

wahrscheinlich das Ergebnis eines Fehlers, der vom zugrundeliegenden

Betriebssystem herrührt. Wenn diese io::Result-Instanz ein Ok-Wert ist, wird

expect den Wert, den Ok hält, als Rückgabewert verwenden, damit du ihn

verwenden kannst. In diesem Fall ist dieser Wert die Anzahl der Bytes, die der

Benutzer in die Standardeingabe eingegeben hat.

Wenn du nicht expect aufrufst, wird das Programm kompiliert, aber du erhältst

eine Warnung:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

warning: unused `Result` that must be used

--> src/main.rs:10:5

|

10 | io::stdin().read_line(&mut guess);

| ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

|

= note: this `Result` may be an `Err` variant, which should be handled

= note: `#[warn(unused_must_use)]` on by default

help: use `let _ = ...` to ignore the resulting value

|

10 | let _ = io::stdin().read_line(&mut guess);

| +++++++

warning: `guessing_game` (bin "guessing_game") generated 1 warning

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.59s

Rust warnt, dass du den von read_line zurückgegebenen Result-Wert nicht

verwendet hast, was darauf hinweist, dass das Programm einen möglichen Fehler

nicht behandelt hat.

Der richtige Weg, die Warnung zu unterdrücken, ist eine Fehlerbehandlung zu

schreiben, aber da wir dieses Programm einfach nur abbrechen wollen, wenn ein

Problem auftritt, können wir expect verwenden. In Kapitel 9

erfährst du, wie man sich von Fehlern erholt.

Ausgeben von Werten mit println!-Platzhaltern

Abgesehen von der schließenden geschweiften Klammer gibt es in dem bisher hinzugefügten Code nur noch eine weitere Zeile zu besprechen:

use std::io;

fn main() {

println!("Rate die Zahl!");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Diese Zeile gibt den String aus, der jetzt die Eingabe des Benutzers enthält.

Das Paar geschweifter Klammern {} ist ein Platzhalter: Stelle dir {} wie

kleine Krebszangen vor, die einen Wert an Ort und Stelle halten. Wenn du den

Wert einer Variablen ausgibst, kann der Variablenname innerhalb der geschweiften

Klammern stehen. Wenn du das Ergebnis der Auswertung eines Ausdrucks ausgeben

willst, füge leere geschweifte Klammern in den Formatierungs-String ein und gib

dann nach dem Formatierungs-String eine durch Komma getrennte Liste von

Ausdrücken ein, die in jedem leeren geschweiften Klammerplatzhalter in derselben

Reihenfolge ausgegeben werden sollen. Das Ausgeben einer Variablen und des

Ergebnisses eines Ausdrucks in einem Aufruf von println! würde wie folgt

aussehen:

#![allow(unused)]

fn main() {

let x = 5;

let y = 10;

println!("x = {x} und y + 2 = {}", y + 2);

}Dieser Code würde x = 5 und y + 2 = 12 ausgeben.

Testen des ersten Teils

Testen wir den ersten Teil des Ratespiels. Führe ihn mit cargo run aus:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 6.44s

Running `target/debug/guessing_game`

Rate die Zahl!

Bitte gib deine Schätzung ein.

6

Du hast geschätzt: 6

An diesem Punkt ist der erste Teil des Spiels abgeschlossen: Wir erhalten eine Eingabe über die Tastatur und geben sie dann aus.

Generieren einer Geheimzahl

Als Nächstes müssen wir eine Geheimzahl generieren, die der Benutzer versucht zu

erraten. Die Geheimzahl sollte jedes Mal anders sein, damit das Spiel mehr als

einmal Spaß macht. Wir werden eine Zufallszahl zwischen 1 und 100 verwenden,

damit das Spiel nicht zu schwierig wird. Rust enthält noch keine

Zufallszahl-Funktionalität in seiner Standardbibliothek. Das Rust-Team stellt

jedoch eine Crate rand mit besagter Funktionalität zur Verfügung.

Mehr Funktionalität mit einer Crate

Denke daran, dass eine Crate eine Sammlung von Rust-Quellcode-Dateien ist. Unser

Projekt „Ratespiel“ ist eine binäre Crate, die eine ausführbare Datei ist. Die

Crate rand ist eine Bibliotheks-Crate (library crate), die Code enthält, der

in anderen Programmen verwendet werden soll.

Das Koordinieren von externen Crates ist der Bereich, in dem Cargo glänzt. Bevor

wir Code schreiben können, der rand benutzt, müssen wir die Datei Cargo.toml

so modifizieren, dass die Crate rand als Abhängigkeit eingebunden wird. Öffne

jetzt diese Datei und füge die folgende Zeile unten unter der Überschrift des

Abschnitts [dependencies] hinzu, den Cargo für dich erstellt hat. Stelle

sicher, dass du rand genau so angibst, wie wir es hier getan haben,

andernfalls funktionieren die Codebeispiele in dieser Anleitung möglicherweise

nicht.

Dateiname: Cargo.toml

[dependencies]

rand = "0.8.5"

In der Datei Cargo.toml ist alles, was nach einer Überschrift folgt, Teil

dieses Abschnitts, der so lange andauert, bis ein anderer Abschnitt beginnt. Im

Abschnitt [dependencies] teilst du Cargo mit, von welchen externen Crates dein

Projekt abhängt und welche Versionen dieser Crates du benötigst. In diesem Fall

spezifizieren wir die Crate rand mit dem semantischen Versionsspezifikator

0.8.5. Cargo versteht semantische Versionierung (manchmal auch

SemVer genannt), was ein Standard zum Schreiben von Versionsnummern ist. Die

Angabe 0.8.5 ist eigentlich die Abkürzung für ^0.8.5, was für alle Versionen

ab 0.8.5 und kleiner als 0.9.0 steht.

Cargo geht davon aus, dass die öffentliche API dieser Versionen kompatibel zur

Version 0.8.5 ist und diese Angabe stellt sicher, dass du die neueste

Patch-Version erhältst, die noch mit dem Code in diesem Kapitel kompiliert

werden kann. Ab Version 0.9.0 ist nicht garantiert, dass die API mit der in

den folgenden Beispielen verwendeten übereinstimmt.

Lass uns nun, ohne den Code zu ändern, das Projekt bauen, wie in Listing 2-2 gezeigt.

$ cargo build

Updating crates.io index

Locking 15 packages to latest Rust 1.85.0 compatible versions

Adding rand v0.8.5 (available: v0.9.0)

Compiling proc-macro2 v1.0.93

Compiling unicode-ident v1.0.17

Compiling libc v0.2.170

Compiling cfg-if v1.0.0

Compiling byteorder v1.5.0

Compiling getrandom v0.2.15

Compiling rand_core v0.6.4

Compiling quote v1.0.38

Compiling syn v2.0.98

Compiling zerocopy-derive v0.7.35

Compiling zerocopy v0.7.35

Compiling ppv-lite86 v0.2.20

Compiling rand_chacha v0.3.1

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 2.48s

Listing 2-2: Die Ausgabe beim Ausführen von cargo build nach dem Hinzufügen der Crate rand als Abhängigkeit

Möglicherweise siehst du unterschiedliche Versionsnummern (aber dank SemVer sind sie alle mit dem Code kompatibel!) und unterschiedliche Zeilen (je nach Betriebssystem), und die Zeilen können in einer anderen Reihenfolge erscheinen.

Wenn wir eine externe Abhängigkeit einfügen, holt Cargo die neuesten Versionen von allem, was die Abhängigkeit aus der Registry benötigt, was eine Kopie der Daten von Crates.io ist. Crates.io ist der Ort, an dem die Menschen im Rust-Ökosystem ihre Open-Source-Rustprojekte für andere zur Nutzung bereitstellen.

Nach dem Aktualisieren der Registry überprüft Cargo den Abschnitt

[dependencies] und lädt alle aufgelisteten Crates herunter, die noch nicht

heruntergeladen wurden. Obwohl wir nur rand als Abhängigkeit aufgelistet

haben, hat sich Cargo in diesem Fall auch andere Crates geschnappt, von denen

rand abhängig ist, um zu funktionieren. Nachdem die Crates heruntergeladen

wurden, kompiliert Rust sie und kompiliert dann das Projekt mit den verfügbaren

Abhängigkeiten.

Wenn du gleich wieder cargo build ausführst, ohne irgendwelche Änderungen

vorzunehmen, erhältst du keine Ausgabe außer der Zeile Finished. Cargo weiß,

dass es die Abhängigkeiten bereits heruntergeladen und kompiliert hat, und du

hast in deiner Datei Cargo.toml nichts daran geändert. Cargo weiß auch, dass

du nichts an deinem Code geändert hast, also wird dieser auch nicht neu

kompiliert. Ohne etwas zu tun zu haben, wird es einfach beendet.

Wenn du die Datei src/main.rs öffnest, eine triviale Änderung vornimmst und sie dann speicherst und neu baust, siehst du nur zwei Zeilen Ausgabe:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 2.53 secs

Diese Zeilen zeigen, dass Cargo nur den Build mit deiner winzigen Änderung an der Datei src/main.rs aktualisiert. Deine Abhängigkeiten haben sich nicht geändert, sodass Cargo weiß, dass es wiederverwenden kann, was es bereits heruntergeladen und kompiliert hat.

Sicherstellen reproduzierbarer Builds

Cargo verfügt über einen Mechanismus, der sicherstellt, dass du jedes Mal, wenn

du oder jemand anderes deinen Code baut, dasselbe Artefakt neu erstellen kannst:

Cargo wird nur die Versionen der von dir angegebenen Abhängigkeiten verwenden,

bis du etwas anderes angibst. Nehmen wir beispielsweise an, dass nächste Woche

Version 0.8.6 der Crate rand herauskommt und eine wichtige Fehlerkorrektur

enthält, aber auch eine Regression, die deinen Code bricht. Um dies zu

handhaben, erstellt Rust die Datei Cargo.lock beim ersten Mal, wenn du cargo build ausführst, die nun im guessing_game-Verzeichnis liegt.

Wenn du ein Projekt zum ersten Mal baust, ermittelt Cargo alle Versionen der Abhängigkeiten, die den Kriterien entsprechen, und schreibt sie dann in die Datei Cargo.lock. Wenn du dein Projekt in der Zukunft baust, wird Cargo sehen, dass die Datei Cargo.lock existiert und die dort angegebenen Versionen verwenden, anstatt die ganze Arbeit der Versionsfindung erneut zu machen. Auf diese Weise erhältst du automatisch einen reproduzierbaren Build. Mit anderen Worten, dein Projekt bleibt dank der Datei Cargo.lock auf 0.8.5, bis du explizit die Versionsnummer erhöhst. Da die Datei Cargo.lock für das reproduzierbare Bauen wichtig ist, wird sie oft zusammen mit dem restlichen Code deines Projekts in die Versionskontrolle eingecheckt.

Aktualisieren einer Crate, um eine neue Version zu erhalten

Wenn du eine Crate aktualisieren willst, bietet Cargo den Befehl update an,

der die Datei Cargo.lock ignoriert und alle neuesten Versionen, die deinen

Spezifikationen entsprechen, in Cargo.toml herausfindet. Cargo schreibt diese

Versionen dann in die Datei Cargo.lock. Andernfalls wird Cargo standardmäßig

nur nach Versionen größer als 0.8.5 und kleiner als 0.9.0 suchen. Wenn die Crate

rand zwei neue Versionen 0.8.6 und 0.999.0 veröffentlicht hat, würdest du

folgendes sehen, wenn du cargo update ausführst:

$ cargo update

Updating crates.io index

Locking 1 package to latest Rust 1.85.0 compatible version

Updating rand v0.8.5 -> v0.8.6 (available: v0.999.0)

Cargo ignoriert die Version 0.999.0. An diesem Punkt würdest du auch eine

Änderung in deiner Datei Cargo.lock bemerken, die feststellt, dass die Version

der Crate rand, die du jetzt benutzt, 0.8.6 ist. Um die rand-Version 0.999.0

oder irgendeine Version aus der 0.999.x-Serie zu verwenden, müsstest du

stattdessen die Datei Cargo.toml anpassen, damit sie wie folgt aussieht.

(Führe diese Änderung nicht durch, da die folgenden Beispiele davon ausgehen,

dass du rand 0.8 verwendest.)

[dependencies]

rand = "0.999.0"

Wenn du das nächste Mal cargo build ausführst, wird Cargo die Registry der

verfügbaren Crates aktualisieren und deine rand-Anforderungen entsprechend der

von dir angegebenen neuen Version neu bewerten.

Es gibt noch viel mehr über Cargo und sein Ökosystem zu sagen, das wir in Kapitel 14 besprechen werden, aber für den Moment ist das alles, was du wissen musst. Cargo macht es sehr einfach, Bibliotheken wiederzuverwenden, sodass die Rust-Entwickler in der Lage sind, kleinere Projekte zu schreiben, die aus einer Reihe von Paketen zusammengestellt werden.

Generieren einer Zufallszahl

Beginnen wir mit rand, um eine Zahl zum Raten zu erzeugen. Der nächste

Schritt ist src/main.rs zu ändern, wie in Listing 2-3 gezeigt.

Dateiname: src/main.rs

use std::io;

use rand::Rng;

fn main() {

println!("Rate die Zahl!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("Die Geheimzahl ist: {secret_number}");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

}Listing 2-3: Hinzufügen von Code zum Generieren einer Zufallszahl

Zuerst fügen wir die Zeile use rand::Rng; hinzu. Das Trait (Merkmal) Rng

definiert Methoden, die Zufallszahlengeneratoren implementieren, und dieses

Trait muss im Gültigkeitsbereich sein, damit wir diese Methoden verwenden

können. In Kapitel 10 werden Traits im Detail behandelt.

Als nächstes fügen wir zwei Zeilen in der Mitte hinzu. In der ersten Zeile rufen

wir die Funktion rand::thread_rng auf, die uns den speziellen

Zufallszahlengenerator zurückgibt, den wir verwenden werden: Einen, der lokal

zum aktuellen Thread ist und vom Betriebssystem initialisiert (seeded) wird.

Dann rufen wir die Methode gen_range des Zufallszahlengenerators auf. Diese

Methode wird durch das Trait Rng definiert, das wir mit der Anweisung use rand::Rng; in den Gültigkeitsbereich gebracht haben. Die Methode gen_range

nimmt einen Bereichsausdruck als Argument und generiert eine Zufallszahl in

diesem Bereich. Ein Bereichsausdruck hat die Form start..=end und er

beinhaltet die Untergrenze und die Obergrenze, sodass wir 1..=100 angeben

müssen, um eine Zahl zwischen 1 und 100 zu erhalten.

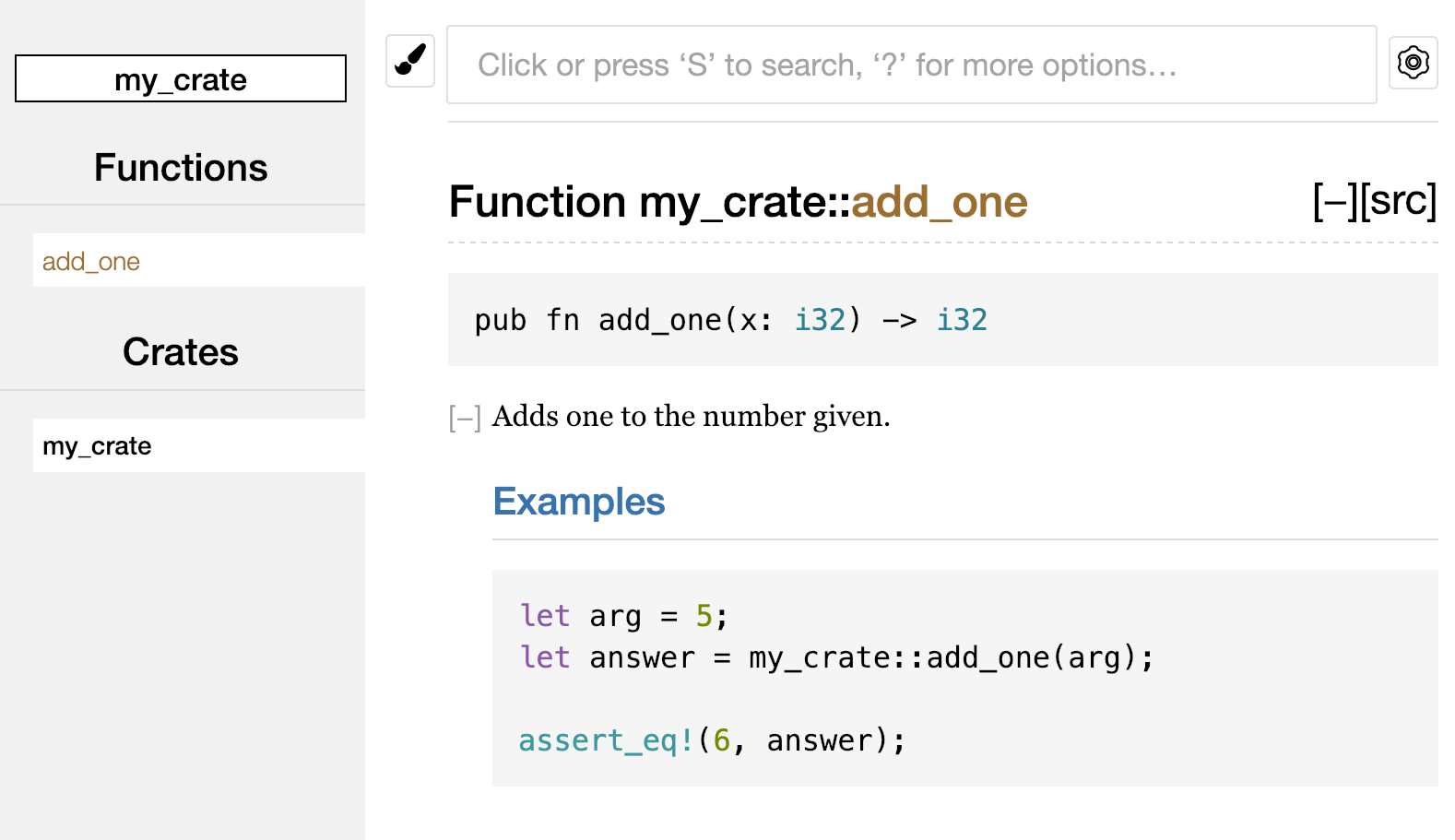

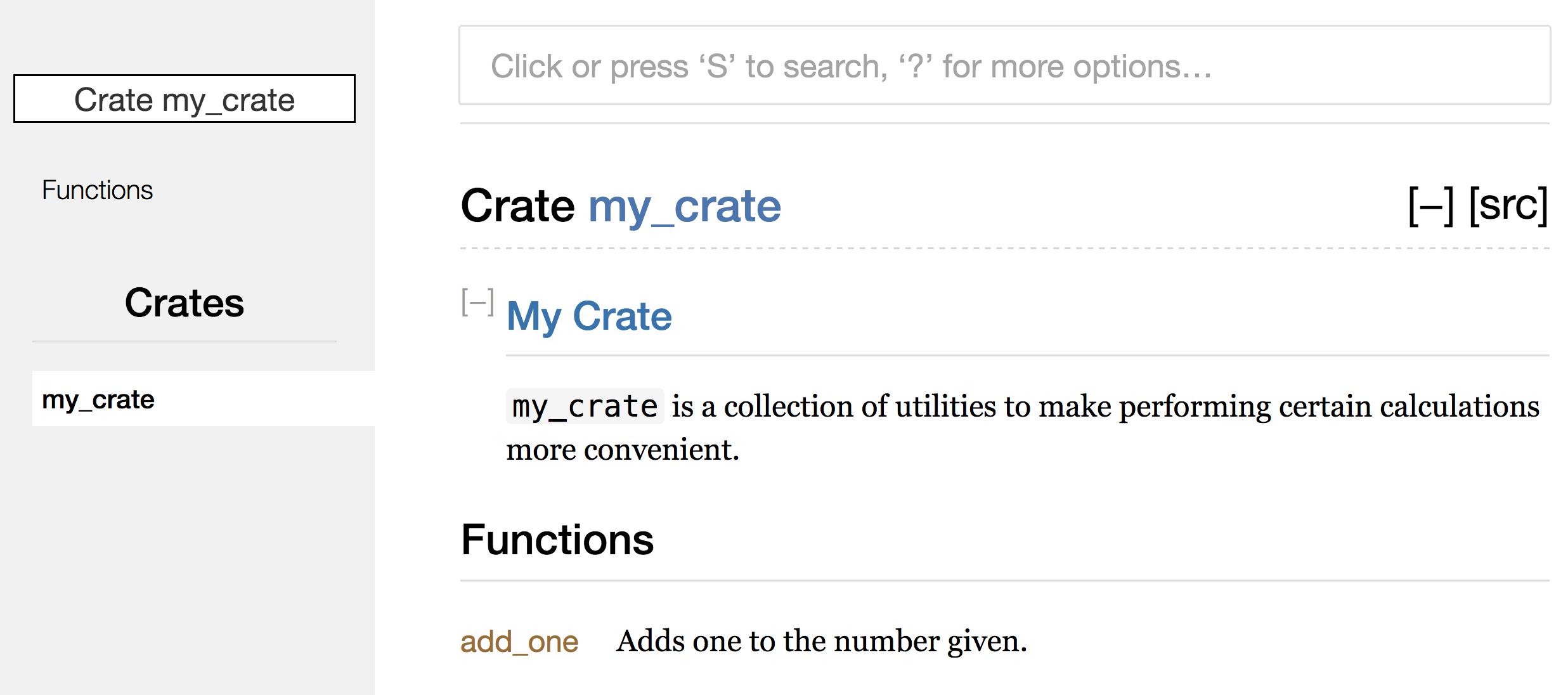

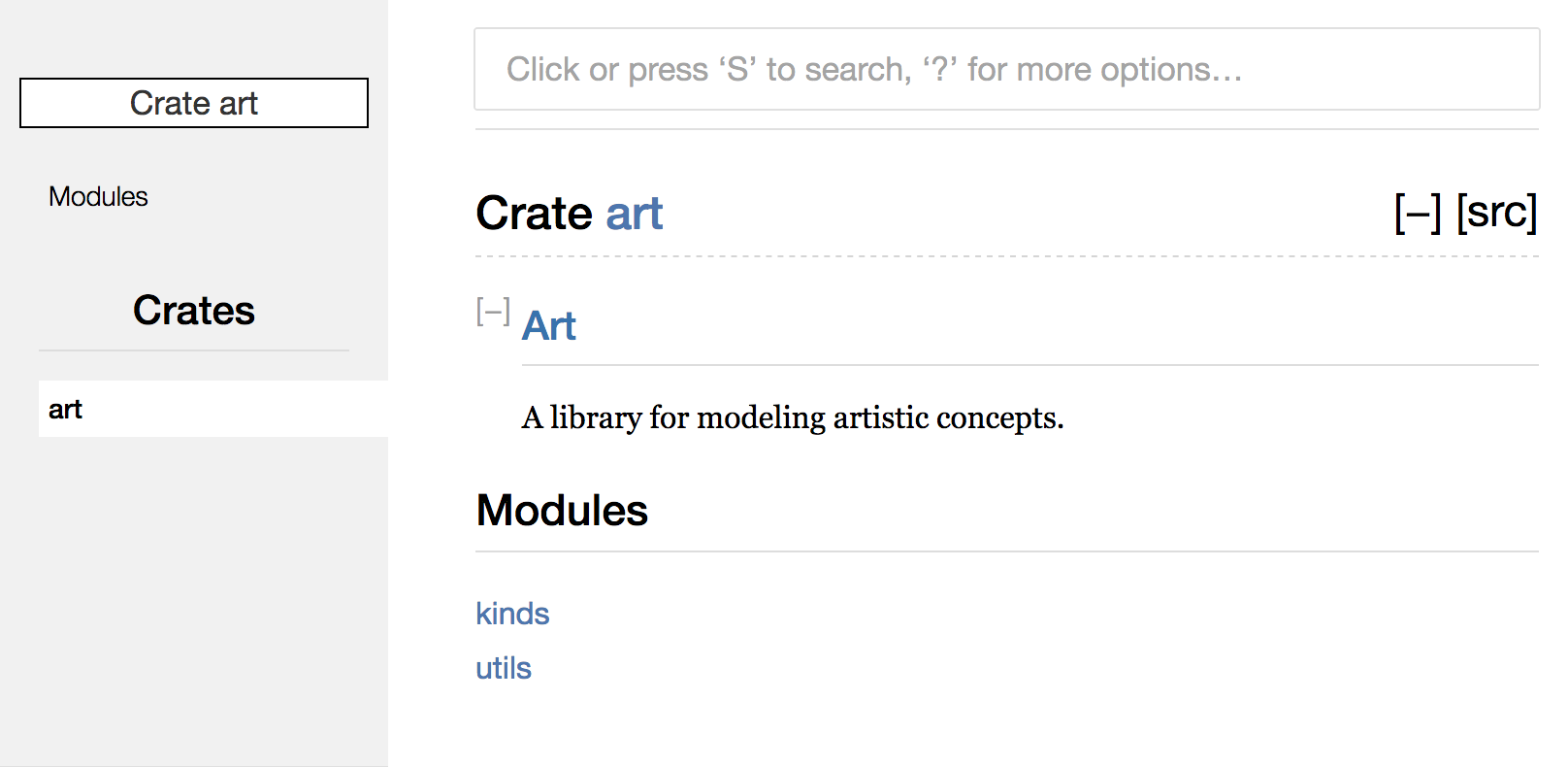

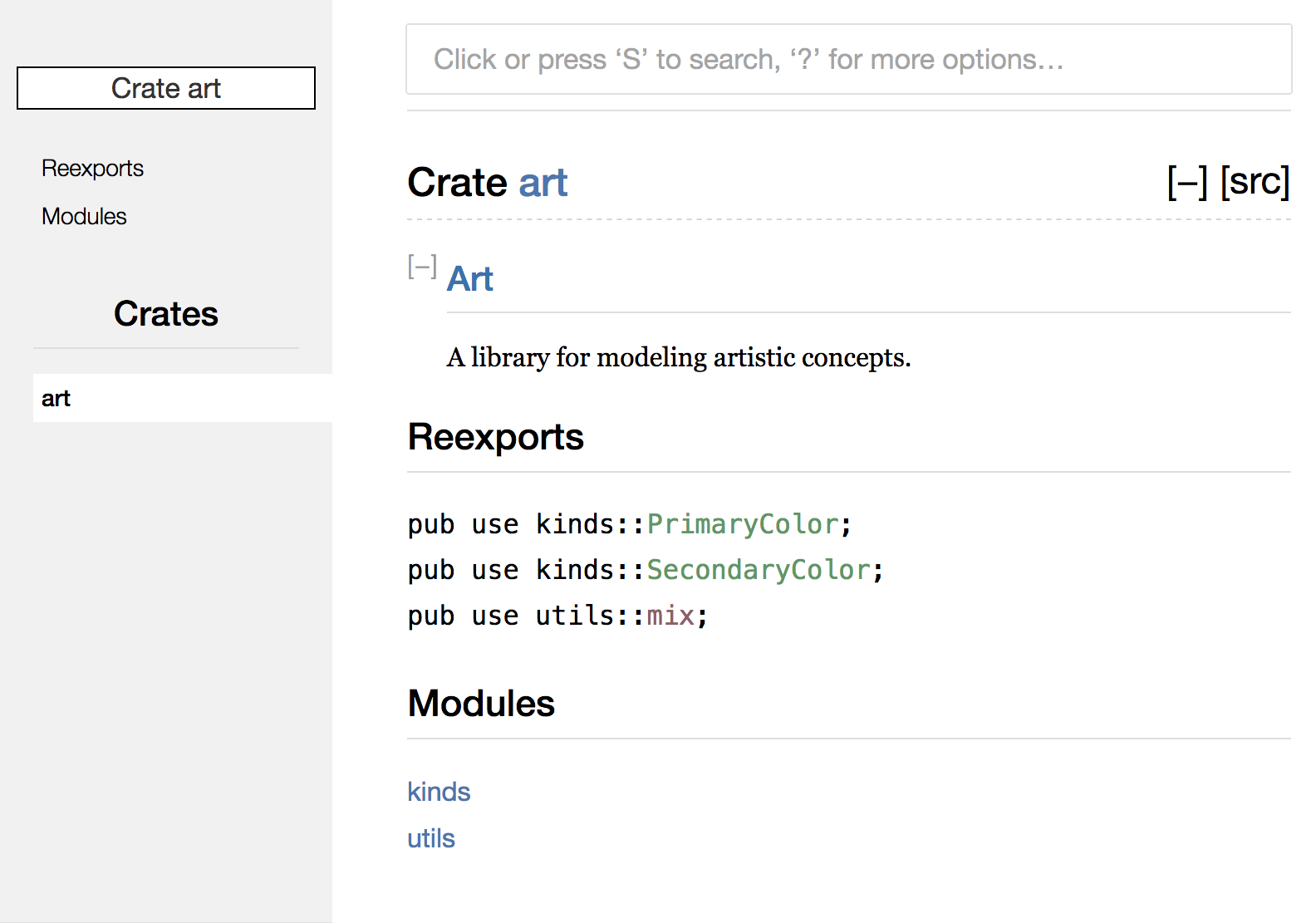

Hinweis: Du wirst nicht immer wissen, welche Traits du verwenden sollst und welche Methoden und Funktionen einer Crate du aufrufen musst, daher hat jede Crate eine Dokumentation mit einer Anleitung zur Verwendung der Crate. Eine weitere nette Funktionalität von Cargo ist, dass das Ausführen des Kommandos

cargo doc --opendie von all deinen Abhängigkeiten bereitgestellte Dokumentation lokal zusammenstellt und in deinem Browser öffnet. Wenn du an anderen Funktionen der Craterandinteressiert bist, führe zum Beispielcargo doc --openaus und klicke aufrandin der Seitenleiste links.

Die zweite neue Zeile gibt die Geheimzahl aus. Das ist hilfreich während wir das Programm entwickeln, um es testen zu können, aber wir werden es aus der finalen Version entfernen. Es ist kein echtes Spiel, wenn das Programm die Antwort ausgibt, sobald es startet!

Versuche, das Programm einige Male auszuführen:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 2.53s

Running `target/debug/guessing_game`

Rate die Zahl!

Die Geheimzahl ist: 7

Bitte gib deine Schätzung ein.

4

Du hast geschätzt: 4

$ cargo run

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.02s

Running `target/debug/guessing_game`

Rate die Zahl!

Die Geheimzahl ist: 83

Bitte gib deine Schätzung ein.

5

Du hast geschätzt: 5

Du solltest verschiedene Zufallszahlen erhalten und sie sollten alle zwischen 1 und 100 sein. Großartige Arbeit!

Vergleichen der Schätzung mit der Geheimzahl

Jetzt, da wir eine Benutzereingabe und eine Zufallszahl haben, können wir sie vergleichen. Dieser Schritt ist in Listing 2-4 dargestellt. Beachte, dass sich dieser Code noch nicht ganz kompilieren lässt, wie wir erklären werden.

Dateiname: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

// --abschneiden--

println!("Rate die Zahl!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("Die Geheimzahl ist: {secret_number}");

println!("Bitte gib deine Schätzung ein.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

println!("Du hast geschätzt: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Zu klein!"),

Ordering::Greater => println!("Zu groß!"),

Ordering::Equal => println!("Du hast gewonnen!"),

}

}Listing 2-4: Behandeln der möglichen Rückgabewerte beim Vergleich zweier Zahlen

Zuerst fügen wir eine weitere use-Anweisung hinzu, die einen Typ namens

std::cmp::Ordering aus der Standardbibliothek in den Gültigkeitsbereich

bringt. Der Typ Ordering ist eine weitere Aufzählung und hat die Varianten

Less, Greater und Equal. Dies sind die drei Ergebnisse, die möglich sind,

wenn man zwei Werte vergleicht.

Dann fügen wir unten fünf neue Zeilen hinzu, die den Typ Ordering verwenden.

Die Methode cmp vergleicht zwei Werte und kann auf alles, was verglichen

werden kann, angewendet werden. Sie braucht eine Referenz auf das, was du

vergleichen willst: Hier wird guess mit secret_number verglichen. Dann gibt

sie eine Variante der Ordering-Aufzählung zurück, die wir mit der

use-Anweisung in den Gültigkeitsbereich gebracht haben. Wir verwenden einen

match-Ausdruck, um zu entscheiden, was als nächstes zu tun ist,

basierend darauf, welche Ordering-Variante vom Aufruf von cmp mit den

Werten in guess und secret_number zurückgegeben wurde.

Ein match-Ausdruck besteht aus Zweigen (arms). Ein Zweig besteht aus einem

Muster (pattern) und dem Code, der ausgeführt werden soll, wenn der Wert, der

am Anfang des match-Ausdrucks steht, zum Muster dieses Zweigs passt. Rust

nimmt den Wert, der bei match angegeben wurde, und schaut nacheinander durch

das Muster jedes Zweigs. Das match-Konstrukt und die Muster sind mächtige

Funktionalitäten in Rust, mit denen du eine Vielzahl von Situationen ausdrücken

kannst, auf die dein Code stoßen könnte, und die sicherstellen, dass du sie

alle behandelst. Diese Funktionalitäten werden ausführlich in Kapitel 6 bzw.

Kapitel 18 behandelt.

Gehen wir ein Beispiel dafür durch, was mit dem hier verwendeten

match-Ausdruck geschehen würde. Angenommen, der Benutzer hat 50 geschätzt und

die zufällig generierte Geheimzahl ist diesmal 38.

Wenn der Code 50 mit 38 vergleicht, gibt die Methode cmp Ordering::Greater

zurück, weil 50 größer als 38 ist. Der match-Ausdruck erhält den Wert

Ordering::Greater und beginnt mit der Überprüfung des Musters jedes Zweigs.

Er schaut auf das Muster Ordering::Less des ersten Zweigs und sieht, dass der

Wert Ordering::Greater nicht mit Ordering::Less übereinstimmt, also

ignoriert er den Code in diesem Zweig und geht zum nächsten Zweig über. Das

Muster Ordering::Greater des nächsten Zweigs passt zu Ordering::Greater!

Der dazugehörige Code in diesem Zweig wird ausgeführt und Zu groß! auf den

Bildschirm ausgegeben. Der match-Ausdruck endet nach der ersten erfolgreichen

Übereinstimmung, sodass der letzte Zweig in diesem Szenario nicht

berücksichtigt wird.

Der Code in Listing 2-4 lässt sich jedoch noch nicht kompilieren. Lass es uns versuchen:

$ cargo build

Compiling libc v0.2.86

Compiling getrandom v0.2.2

Compiling cfg-if v1.0.0

Compiling ppv-lite86 v0.2.10

Compiling rand_core v0.6.2

Compiling rand_chacha v0.3.0

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

error[E0308]: mismatched types

--> src/main.rs:22:21

|

22 | match guess.cmp(&secret_number) {

| --- ^^^^^^^^^^^^^^ expected `&String`, found `&{integer}`

| |

| arguments to this method are incorrect

|

= note: expected reference `&String`

found reference `&{integer}`

note: method defined here

--> /rustc/07dca489ac2d933c78d3c5158e3f43beefeb02ce/library/core/src/cmp.rs:814:8

For more information about this error, try `rustc --explain E0308`.

error: could not compile `guessing_game` (bin "guessing_game") due to 1 previous error

Der Kern der Fehlermeldung besagt, dass die Typen nicht übereinstimmen. Rust hat

ein starkes, statisches Typsystem. Es hat jedoch auch eine Typ-Inferenz. Als wir

let mut guess = String::new() schrieben, konnte Rust daraus schließen, dass

guess ein String sein sollte, und zwang uns nicht, den Typ anzugeben. Die

secret_number hingegen ist ein Zahlentyp. Einige Zahlentypen können einen Wert

zwischen 1 und 100 haben: i32, eine 32-Bit-Zahl; u32, eine 32-Bit-Zahl ohne

Vorzeichen; i64, eine 64-Bit-Zahl; sowie andere. Solange nicht anders

angegeben, verwendet Rust standardmäßig i32, was der Typ von secret_number

ist, es sei denn, du fügst an anderer Stelle Typinformationen hinzu, die Rust

veranlassen würden, auf einen anderen numerischen Typ zu schließen. Der Grund

für den Fehler liegt darin, dass Rust einen String und einen Zahlentyp nicht

vergleichen kann.

Letztendlich wollen wir den String, den das Programm als Eingabe liest, in

einen Zahlentyp umwandeln, damit wir ihn numerisch mit der Geheimzahl

vergleichen können. Das tun wir, indem wir Folgendes zum main-Funktionsrumpf

hinzufügen:

Dateiname: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Rate die Zahl!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("Die Geheimzahl ist: {secret_number}");

println!("Bitte gib deine Schätzung ein.");

// --abschneiden--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Fehler beim Lesen der Zeile");

let guess: u32 = guess.trim().parse().expect("Bitte gib eine Zahl ein!");

println!("Du hast geschätzt: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Zu klein!"),

Ordering::Greater => println!("Zu groß!"),

Ordering::Equal => println!("Du hast gewonnen!"),

}

}Die Zeile lautet: